|

DOI: 10.25136/2409-7543.2020.2.31937

Received:

10-01-2020

Published:

31-05-2020

Abstract:

The subject of this research is the application of autonomous robotic systems of various designation. The object of this research is the algorithmic problems emerging in this area, namely the problem of control over security of algorithms. The study is carried out on the basis of implementation of robotics in military sphere. The analysis of peculiarities of the modern military operations demonstrates that one of the aspects of revolution in military science is the battlefield robotics. However, its realization generates certain issues in legal sphere, related to algorithmic support of the autonomous system. The manifestations of such problem consist in critical use errors, divided by the experts into the errors of first and second grade. The main cause of these errors is the software functionality of the autonomous robotic system. If the consequences for conventional armament are predictable, and the responsibility for their results is determined, the situation in case of implementation of military robots requires solution. Application of the general scientific methods of analysis and synthesis allow examining the main aspects of current state and prospects of the problem of algorithmization with regards to implementation of autonomous systems. The article synthesizes articulation of the scientific tasks aimed at solution of the problem of division of responsibility between the developers and users of similar system in terms of development and testing of the algorithms of their implementation.

Keywords:

problems of robotics, legal problems of robotics, algorithmic support, robotics battlefield, lethal autonomous robotics, algorithm control, artificial Intelligence, modifiable algorithms, developer responsibility, user responsibility

Введение

Одна из тенденций развития робототехники – создание и применение автономных роботов. Появление этой тенденции обусловлено многими факторами: динамичностью современного мира, глобализацией и ростом масштабов управляемых систем, их распределённостью и мультиагентностью. В таких условиях оператор, довольно часто, является «слабым звеном» системы, и автономизация робототехнических систем становится объективно необходимой. Но её внедрению мешают объективные и субъективные факторы: сложность разработки необходимого для автономной работы программного обеспечения, нерешенность проблемы разделения ответственности за результаты применения автономных роботов, определённое недоверие пользователей к системе, способной к самостоятельным действиям, ответственность за возможные критичные ошибки поведения автономных систем [1-6].

Таким образом, как показывает анализ, существует целый ряд объективных проблемы разработки и использования автономных роботов, которые требуется решить для запуска процесса автономизации. Существенная часть этих проблем определяется тем, что автономная система должна действовать не просто по заранее разработанным алгоритмам, как это происходит сейчас в системах, смело, но несколько безосновательно, именуемых «интеллектуальными»: алгоритмы должны модифицироваться в ходе применения, автономная система должна быть не просто обучаемой, а самообучаемой. Причём, итогом самообучения должен быть не просто рациональный выбор лучших вариантов поведения из массива заранее подготовленных алгоритмов, а их модификация с учётом меняющихся условий поведения [7]. И тут возникает проблема, находящаяся на стыке правовой и технической областей регулирования: все методики оценки безопасности, разделения ответственности между разработчиком и эксплуатантом за применение автономных систем основаны на принципе неизменности разработанных и заложенных в робототехническую систему алгоритмов, определяющих области ответственности каждого участника процесса разработки, производства и применения [8-11]. В том числе, за счёт выноса «за скобки» наиболее критичных вопросов, возникающих при эксплуатации, например, за счёт делегирования принятия конечного решения в ряде ситуаций человеку-оператору. Если алгоритм модифицируемый, то разработчик не может отвечать за применение робототехнической системы после модификации того, что он разработал, а эксплуатант не может полноценно управлять системой с неизвестными ему правилами поведения. Проблема модификации алгоритмов, может быть, не самая заметная, но одна из наиболее существенных для автономной робототехники, в первую очередь, исходя из того, что программная «начинка» - это основа поведения автономной системы.

1.Существующий подход к оценке алгоритмов

Особенно заметна ситуация с проблемами алгоритмического обеспечения использования автономных роботов в военной сфере. Требования к автономности боевых робототехнических систем определяются особенностями ведения современных военных действий: необходимостью обеспечения оперативности решения задач в условиях неопределённой и динамично меняющейся обстановки, необходимость согласованного группового применения, в форме «роя», координация которого осуществляется без участия оператора. При этом объективное требование автономизации применения входит в противоречие с необходимостью обеспечения безопасности применения для своих войск и не комбатантов. Последнее особенно актуально в связи с тем, что большинство современных вооруженных конфликтов ведётся в урбанизированной местности, порой без возможности эвакуировать мирное население. Осознавая это, разработчики систем, реализующих компоненты искусственного интеллекта, стремятся принять определённые меры безопасности. Примером может служить концепция использования искусственного интеллекта в военном деле, разработанная в ВС США [12]. Она содержит ряд принципов использования систем искусственного интеллекта в военных целях:

· ответственность за применение систем искусственного интеллекта, который должен применяться только в тех системах и ситуациях, где его применение обусловлено необходимостью;

· беспристрастность, минимизация нежелательных отклонений в поведении систем искусственного интеллекта;

· прослеживаемость, понимание эксплуатантами процессов разработки и принципов поведения систем;

· надежность, определяемая тем, что возможности военных систем искусственного интеллекта должны быть однозначными, четко сформулированы, а их безопасность и эффективность должны проверяться испытаниями и периодически подтверждаться на протяжении всего срока службы.

· подчинение, определяемое тем, что боевые системы искусственного интеллекта должны полностью исполнять предназначенные для них задачи, но военные должны иметь возможность обнаруживать и предотвращать нежелательные последствия использования искусственного интеллекта, иметь возможность выводить из боя или выключать системы, у которых были замечены отклонения в работе.

Напрашивается очевидный вывод – большинство пунктов данной концепции предусматривают контроль алгоритмов применения систем с элементами искусственного интеллекта, как одного из основных источников потенциальных проблем.

В других сферах проблеме контроля поведения робототехнических систем, в первую очередь, автономных, оказывается не меньшее внимание. В Рекомендации Парламентской Ассамблеи Совета Европы №2102 (2017) от 28.04.2017 «Слияние с технологиями, искусственный интеллект и права человека» напрямую сформулированы требования по обеспечению безопасности алгоритмов интеллектуальных систем (пункт 9.3), в том числе роботизированных [13]. В документах комиссии по гражданско-правовому регулированию в сфере робототехники Европейского Парламента данные положения детализированы, но в её предложениях, как и в самих Рекомендациях и документах, изданных как до, так и после них, не содержится описание того, как указанные требования будут выполняться при разработке и эксплуатации робототехнических систем [14]. Соответственно, задача контроля алгоритмов в робототехнике требует конкретного метода решения, которого пока не существует.

Впрочем, проблему контроля поведения робототехнических систем, в том числе, определяемую совершенством их алгоритмов, уже не раз обсуждали футуристы и писатели. Одним из первых в подобной постановке, данную проблему озвучил Айзек Азимов, разработав три закона робототехники. Но это было сделано на раннем этапе развития, когда ещё не было нейросетей и других подходов к описанию алгоритмов поведения автономных систем, да и сам принцип был сформулирован с самом общем, описательном, виде. Но принцип в основу сформулированных законов робототехники положен верный: для обеспечения безопасности требуются определённые алгоритмические ограничения, а для автономных систем - самоограничения. В рассматриваемом случае – ограничения на модификацию алгоритмов.

В то же время, сейчас разработка алгоритмов, реализуемых в составе программного обеспечения (ПО) робототехнических систем осуществляется по определённым правилам, задаваемым в нормативной документации: соответствующих российских ГОСТ, и стандартов, реализующих технологию RUP (Rational Unified Process) за рубежом. Этими документами, с учётом особенностей той или иной предметной области, определяется схема и этапность описания требований, определяющих разработку и реализацию алгоритмов, контроля качества реализующего их программного обеспечения (ПО), порядок его внедрения и эксплуатации.

Обобщённый вариант типовой схемы разработки управляющего компонента автономных робототехнических систем – ПО, соответствующая действующим нормативным документам [15,16], приведена на рисунке 1.

Рисунок 1 – Существующий подход к контролю алгоритмов, реализуемых в программном обеспечении

Отметим, что эта схема изначально ориентирована на разработку «жестких» (не модифицируемых) алгоритмов, начиная от постановки задачи и до тестирования алгоритмов в составе конкретной программной реализации. Механизм тестирования модифицируемых алгоритмов – ни в ГОСТ, ни в стандартах RUP не прописан, так как эти документы создавались тогда, когда необходимости, да и технологической возможности разработки таких алгоритмов не было. С учётом того, что предпринимаемые в настоящее время попытки ограничить использование автономных роботов организационными мерами [13,14,17], привести их применение в рамки определённых ограничений, успеха не имеют, проблема остаётся нерешенной и порождает определённые вопросы, особенно в военной сфере применения робототехники [18-25]. Впрочем, и в сфере мирного использования, до настоящего времени остаются нерешенные проблемы алгоритмизации [26-30]. В рамках существующей системы нормативно-технической документации эти проблемы решены быть не могут.

2.Особенности контроля изменяемых алгоритмов

В то же время, формулируя требования, заказчик и эксплуатанты автономных робототехнических комплексов оперируют такими показателями алгоритмов как: настраиваемость, модифицируемость (обучаемость) и даже самообучаемость. Последнее для того, чтобы сделать автономные системы действительно «интеллектуальными», а не «интелектуализированными», какими они, по сути, являются сейчас. Эти требования объективны, они диктуются условиями сложности и динамичности изменения обстановки, в которой применяются автономные роботы, удалённостью объектов управления от центров принятия решений. С технической точки зрения, эти требования выполнимы уже на современном этапе развития науки и техники. Кроме одного – гарантировать предсказуемость и безопасность поведения робототехнических систем. Решение последней задачи может быть найдено за счёт обеспечения надёжного контроля алгоритмов, заложенных в эти системы, в том числе, с учётом их возможной модификации в ходе эксплуатации (обучения).

Сформулированная задача по своей сущности аналогична одной из важнейших задач искусственного интеллекта: задаче удовлетворения ограничений (constraint satisfaction problem).

Следует отметить, что в прямой постановке задача контроля безопасности модифицируемых и самообучающихся алгоритмов, реализуемых в автономных робототехнических системах, до настоящего времени не ставилась. Соответственно, решение её пока не найдено.

В то же время, похожая задача уже решалась ранее, для «жестких» алгоритмов, реализуемых в неавтономных роботах, например, промышленных. Практика подсказывает, что известное решение, доработанное с учётом особенностей новой задачи, может быть использовано повторно.

Учитывая структуру робототехнических систем, включающих механическую (исполнительную) и программную (управляющую) компоненты, существующие подходы к решению задачи контроля безопасности алгоритмов, с определённой степенью условности, можно разделить на две большие группы: на «внутренние» и «внешние» ограничения алгоритмов.

К «внутренним» ограничениям алгоритмов можно, например, отнести граничные условия, задаваемые при использовании методов оптимизации, то есть ограничения параметров целевой функции: граничные условия, «штрафные» функции и т.п.

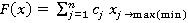

Для типовой задачи оптимизации, они могут быть записаны в виде пары:

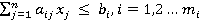

- целевая функция  , ,

максимизирующая (минимизирующая) множество F(x) за счёт подбора показателей хjс коэффициентами сj;

- системы ограничений вида  . .

При использовании такого подхода необходимо учитывать, что ограничения задаются именно для конкретного вида целевой функции, у которой в процессе решения могут меняться только управляемые параметры. Учитывая, что предусмотренная в автономных роботизированных системах модификация алгоритмов поведения может, с высокой вероятностью, приводить к изменению целевой поведенческой функции, применение внутренних ограничений не может однозначно гарантировать безопасность поведения таких систем.

К «внешним» ограничениям можно отнести задание границ поведения системы, описывающей область её возможного применения в виде набора граничных правил. То есть ограничение не отдельных параметров функции F(x), а вариантов итогового значения целевой функции в рамках пространства возможных поведенческих траекторий (областей).

Наиболее простой пример реализации подобного подхода – механические кулисы, ограничивающие амплитуду движения исполнительных элементов промышленных роботов. Известные примеры в части ограничения программных алгоритмов – нанесение специальной разметки для беспилотных автомобилей или те же три правила робототехники, сформулированные Айзеком Азимовым.

Использование «внешних» ограничений представляется более надёжным методом обеспечения безопасности поведения робототехнических систем, хотя и более сложным в части определения общих границ поведения системы, которые требуется описать на всех возможных режимах поведения системы, стараясь при этом не ограничить её функциональные возможности.

3.Постановка задачи ограничения алгоритмов

Возникает проблема выбора между «внутренними» и «внешними» ограничениями, реализуемыми при разработке алгоритмов функционирования автономных робототехнических систем.

Для решения задачи обеспечения безопасности применения автономных робототехнических систем «внутренними» методами, могут быть использованы известные подходы, реализуемые в качестве ограничений в оптимизационных методах поиска оптимума поведенческой функции любой системы: методы поиска на графах с отсечением, методы штрафных функций, методы согласования, методы поиска с возвратом, методы распространения ограничений, генетические, итерационные методы и другие.

В качестве «внешних» ограничений может быть использован принцип задания общих границ поведения системы: в пространстве, во времени и в виде набора разрешенных (запрещённых) логических переменных, описывающих все возможные действия системы.

Оба подхода имеют свои положительные стороны и недостатки, как с точки зрения простоты реализации, так и влияния на ограничения функциональности управляемой системы и обеспечения гарантированной безопасности применения.

Анализ этих характеристик с учётом роли и места ПО, реализующего алгоритмы поведения робототехнических систем в структуре самих таких систем, позволил сделать выводы о влиянии методов ограничений на эффективность и безопасность системы в целом. Результаты сравнения особенностей методов приведены в таблице 1.

Таблица 1 – Сравнение методов ограничения алгоритмов

|

Наименование метода

|

Его сущность

|

Некоторые характеристики

|

|

Простота разработки и реализации

|

Надёжность контроля алгоритма

|

Отсутствие влияния на функциональность систем

|

Возможность контроля модифицирующихся алгоритмов

|

|

Ограничения вне алгоритма («внешние» для системы)

|

Логические ограничения на внешние проявления деятельности

|

+

|

+

|

-

|

+

|

|

Собственные ограничения алгоритмов («внутренние» для системы)

|

Ограничения, аналогичные применяемым в оптимизационных методах динамического программирования («штрафы»)

|

+

|

+

|

+

|

-

|

Анализ существующих подходов показывает некоторую предпочтительность алгоритмов, основанных на «внутренних» ограничениях при сопоставимой сложности их реализации.

Впрочем, для случая использования модифицируемых и самообучающихся алгоритмов, однозначно можно быть уверенным только в надёжности метода внешних ограничений, и, соответственно, применимым остаётся только он. Таким образом, в настоящее время для разработки алгоритмов автономных робототехнических систем может быть использован исключительно принцип реализации «внешних» ограничений. Для его внедрения остаётся описать предельные границы поведения каждой разрабатываемой системы (класса систем) и реализовать «внешние» ограничения на практике.

В то же время, как показывает обзор методов контроля алгоритмов, «внешние» ограничения могут накладывать определённые рамки на применение робототехнической системы, снижая её функционал. Для динамичных систем, особенно военного назначения, этот фактор может быть критичным, как с точки зрения функциональности, так и уязвимости для противника. Не менее важной является эта проблема при реализации «внешних» ограничений в процессе группового применения автономных роботов. А последнее – одно из перспективных направлений их использования, например, в виде «роя» в военной области.

С учётом этого фактора, более перспективными можно всё же считать нереализуемые на современном этапе развития технологий методы «внутреннего» контроля, обладающие большей надежностью при разработке частных алгоритмов.

Исходя из этого, данное направление будет развиваться по мере совершенствования технологий и математических методов. Вероятнее всего, как это происходит обычно – по принципу «от простого к сложному», начиная с простейших алгоритмов, таких, например, как «жадные алгоритмы» (greedy algorithm), в том числе и модифицируемые. Для использования последних, например, достаточно обеспечить условие однозначного доказательства наличия матроида (X, I), где X — конечное множество, именуемое носителем матроида, а I — семейством независимых множеств, являющихся подмножествами X, выполняющего на всём возможном пространстве поведения свойств:

- множество I не пусто;

- любое подмножество любого элемента множества I также будет элементом этого множества;

- eсли множества A и B принадлежат множеству I, а также известно, что размер А меньше B, то существует какой-нибудь элемент x из B, не принадлежащий А, такое что объединение x и A будет принадлежать множеству I. В перспективе, с развитием методологии искусственного интеллекта и совершенствованием технологий, возможности использования «внутренних» ограничений будут расширяться и, вполне вероятно, что именно такой подход станет основным.

Заключение

В данной статье задача ограничения обучающихся алгоритмов сформулирована в самом общем виде. Но проблема, для решения которой сформулирована постановка задачи, крайне актуальна для любых автономных роботов, несущих потенциальную опасность для человека: транспортных и промышленных, обладающих кинетической энергией, боевых, сама цель которых – уничтожение [31-37]. И эта проблема требует скорейшего решения, сначала любым доступным способом, а потом и оптимальным.

Отсутствие решения вызывает опасение, которое ранее выражали футурологи и писатели-фантасты, описывая «восстание машин». И это только усугубляет ситуацию, порождая запреты на развитие технологий, объективно необходимых для создания автономных робототехнических систем, вместо того, чтобы решать проблему в комплексе. Сформулированная в статье постановка задачи может послужить одной из предпосылок к разрешению этой ситуации.

References

1. Voennaya mysl' v terminakh i opredeleniyakh : v 3 t. / sost. N. N. Tyutyunnikov. – M. : Pero, 2018. – T. 3. Informatizatsiya Vooruzhennykh Sil. – 472 s.

2. Simulin A. A. i dr. Nekotorye aspekty ispol'zovaniya robototekhniki v voennom dele // Sborniki konferentsii NITs Sotsiosfera. 2015. - №27. - S.67-71.

3. Hover and stare: FCS testing UAVS // Military.com. – URL: https://www.military.com/defensetech/2008/05/30/hover-and-stare-fcs-testing-uavs (date of access: 30.05.2008).

4. My ubili 4700 chelovek, no eto voina. Amerikanskii senator raskryl chislo zhertv bespilotnikov. Novosti TUT.BY.-URL: https://news.tut.by/world/336031.html (data obrashcheniya: 21.09.2017).

5. Bespilotniki SShA ubivayut bol'shoe chislo mirnykh zhitelei. Novosti aviatsii i kosmonavtiki.-URL: http://avianews.info/bespilotniki-ssha-ubivayut-bolshoe-chislo-mirnyh-zhitelej/ (data obrashcheniya: 21.09.2017).

6. Misheni bespilotnikov v Afganistane: terroristy ili mirnye zhiteli? Mir.-URL: http://www.dw.com/ru/misheni-bespilotnikov-v-afganistane-terroristy-ili-mirnye-zhiteli/a-19200599 (data obrashcheniya: 21.09.2017).

7. Morkhat P.M. Iskusstvennyi intellekt: pravovoi vzglyad: Nauchnaya monografiya / ROO «Institut gosudarstvenno-konfessional'nykh otnoshenii i prava». – M.: Buki Vedi, 2017. – 257 s.

8. Sofge E. America's Robot Army: Are Unmanned Fighters Ready for Combat? // Popular Mechanics. Dec.18 2009.-URL: https://www.popularmechanics.com/military/a2653/4252643/ (date of access: 1.04.2019).

9. Robot targets men in Iraq // Defense Tech. April 2008. URL: https://www.military.com/defensetech/2008/04/17/robot-targets-men-in-iraq (date of access: 19.04.2008).

10. Report of the Special Reporter on extrajudicial, summary or arbitrary executions, Christof Heyns // UN General Assembly. URL:http://www.ohchr.org/Documents/HRBodies/HRCouncil/RegularSession/Session23/A-HRC-23-47_en.pdf (date of access: 5.02.2015).

11. Tobiast T. Gibson. Ethics and new defense technology // The Hill. — URL: https://thehill.com/blogs/pundits-blog/defense/234403-ethics-and-new-defense-technology (date of access: 30.01.2015).

12. DOD Adopts Ethical Principles for Artificial Intelligence. US Dept of Defense. URL: https://www.defense.gov/Newsroom/Releases/Release/Article/2091996/dod-adopts-ethical-principles-for-artificial-intelligence (date of access: 05.03.2020).

13. Recommendation № 2102 (2017) of Parliamentary Assembly of the Council of Europe «Technological convergence, artificial intelligence and human rights», 28 April 2017. URL: (data obrashcheniya 15.04.2020).

14. Recommendation № 2069 (2015) of Parliamentary Assembly of the Council of Europe «Technological convergence, artificial intelligence and human rights», 23 April 2015. URL: (date of access: 15.04.2020).

15. GOST R 60.2.2.1-2016/ ISO 13482: 2014 Roboty i robototekhnicheskie ustroistva. Trebovaniya po bezopasnosti dlya robotov po personal'nomu ukhodu. M.: Standartinform, 2016. – 78 s.

16. GOST R 60.1.2.2-2016/ISO 10218-2:2011. Roboty i robototekhnicheskie ustroistva. Trebovaniya po bezopasnosti dlya promyshlennykh robotov. – M. : Standartinform, 2016. – Ch. 2. – 70 s.

17. V OON obsuzhdaetsya vopros zapreta primeneniya voennykh robotov // Novosti Hi-Tech. URL:http://android-robot.com/v-oon-obsuzhdaetsya-vopros-zapreta-primeneniya-voennyx-robotov (data obrashcheniya: 06.10.2015).

18. Vudvord S. Folklendskaya voina. Memuary komanduyushchego Folklendskoi udarnoi gruppy. – Simferopol' : Dolya, 2005. – 415 c.

19. Chirov D.S., Novak K.V. Perspektivnye napravleniya razvitiya robototekhnicheskikh kompleksov spetsial'nogo naznacheniya // Voprosy bezopasnosti. – 2018. – № 2. – S. 50-59. DOI: 10.25136/2409-7543.2018.2.22737.

20. Khripunov S.P., Blagodaryashchev I.V., Chirov D.S. Voennaya robototekhnika: sovremennye trendy i vektory razvitiya // Trendy i upravlenie. — 2015. — № 4. — S. 410-422.

21. Khodarenok M.M., Kalinin I. Tret'ya strategiya: kak budut voevat' SShA // Sait «Gazeta.RU».-URL: https://www.gazeta.ru/army/2017/11/28/11016068.shtml (data obrashcheniya: 02.12.2017).

22. Army Equipment Program in support of President’s Budget 2016 / US Army G-8, 2015. – 56 p.

23. Capturing technology. Rethinking Arms Control. Conference Reader. – Berlin : German Federal Foreign Office, 2019. – 50 p.

24. Vypasnyak V.I. i dr. O povyshenii effektivnosti primeneniya vysokotochnogo oruzhiya v voennykh konfliktakh lokal'nogo i regional'nogo masshtaba // Vestnik Akademii voennykh nauk. – 2008. – №4(25). – S. 43-48.

25. Tikhanychev O.V. O pravovykh i eticheskikh aspektakh avtonomnogo ispol'zovaniya robototekhnicheskikh kompleksov v sfere vooruzhennogo protivoborstva // Voprosy bezopasnosti. — 2019. - № 3. - S.33-42. DOI: 10.25136/2409-7543.2019.3.28960.

26. Nesterov A. V. Vozmozhny li pravootnosheniya i yuridicheskie vzaimodeistviya mezhdu lyud'mi i robotami? M.: Preprint, sentyabr' 2016. – 14 s.

27. Lopatina T. M. Nekotorye aspekty problemy moral'noi otvetstvennosti komp'yuternykh sistem // Pravovye voprosy svyazi. – 2005. – №1. – s.12-13/.

28. Tikhanychev O.V., Tikhanycheva E.O. Problemy ispol'zovaniya potentsial'no opasnykh tekhnologii v sovremennom mire // Sotsiosfera. – 2017. – № 2. – S. 33-36. DOI: 10.24044/sph.2017.2.6.

29. Bechel W. Attributing Responsibulity to Computer Systems. In: Metaphiiosophy, – №16, – 1985. – P.189.

30. Deborah G. Johnson. Computer Systems: Moral entities but not moral agents. In: Ethics and Information Technology. 2006. – №8. – pp.195-204. DOI 10.1007/s10676-006-9111.

31. Schuller A.L. At the Crossroads of Control: The Intersection of Artificial Intelligence inAutonomous Weapon Systems with International Humanitarian Law // Harvard National Security Journal. – 2017. – Vol. 8. – rr. 379–425.

32. Kholikov I.V., Sazonova K.L. Mezhdunarodno-pravovaya otvetstvennost' v kontekste pravovoi reglamentatsii voennogo ispol'zovaniya bespilotnykh letatel'nykh apparatov // Voennoe pravo. – 2017. – № 4. – S. 217–226.

33. Sheremet I.B., Rudianov N.A., Ryabov A.V., Khrushchev V.S. O neobkhodimosti razrabotki kontseptsii postroeniya i primeneniya avtonomnykh robototekhnicheskikh kompleksov voennogo naznacheniya // Ekstremal'naya robototekhnika. – 2016. – T. 1. – № 1. – S. 35–39.

34. Pflimlin É. Drones et robots: La guerre des futurs. Levallois-Perret (France), 2017. – 96 p.

35. Bugakov I.A., Tsar'kov A.N. Intellektualizatsiya voennoi robototekhniki: terminologicheskaya i tekhnologicheskaya problemy // Izvestiya Instituta inzhenernoi fiziki. – 2017. – T. 3. – № 45. – S. 87–93.

36. Beard J.M. Autonomous weapons and human responsibilities. Georgetown Journal of International Law. – 2014. – Vol. 45. – rr. 617–681.

37. Weaver J.F. Abhor a Vacuum: The Status of Artificial Intelligence and AI Drones Under International Law // New Hampshire Bar Journal. – 2013, Spring/Summer. – rr. 14–21.

|

This work is licensed under a Creative Commons Attribution-NonCommercial 4.0 International License.

This work is licensed under a Creative Commons Attribution-NonCommercial 4.0 International License.